27 миллиардов параметров: почему это больше похоже на «характер», чем на «размер»

«27B» в названии Qwen3.6 — это не про “крутость в цифрах”, а скорее про то, сколько у модели внутри “привычек” и связей, как у человека. Представьте не шкаф с учебниками, а голову, где есть куча наработанных ассоциаций: как обычно продолжать фразу, где искать ошибку в коде, как не терять нить разговора на длинной дистанции. У одной модели это похоже на аккуратную библиотеку с закладками, у другой — на склад, где книг больше, но нужную иногда ищешь дольше.

Вот сцена: вы просите помочь с задачей и даёте длиннющий контекст — переписку, куски документа, пару условий “и ещё важно, чтобы было так-то”. У “27B” ощущение такое, что она не начинает каждый раз с нуля и не паникует от объёма: держит в голове, что вы уже обсуждали пять минут назад, и отвечает более собранно. Как собеседник, который не просто “много знает”, а умеет слушать и не перескакивает. И реакция — живая: меньше воды, меньше повторов, больше смысла с первого раза.

А теперь другая сцена. Берёте гиганта “побольше” — и иногда он, честно, ведёт себя как очень умный человек, который устал: может начать красиво, но потом уехать в сторону, забыть ограничение, предложить лишнее. Меньшая модель при этом может быть “умнее в деле” не потому, что она чудом стала гением, а потому что её тренировали и организовали так, чтобы она попадала в задачу. Это как водитель: не обязательно иметь самый мощный двигатель, чтобы быстро доехать по городу. Важно, как настроена коробка, как работает навигация, и умеешь ли ты не метаться на каждом перекрёстке.

И ещё момент, который прямо ощущается пользователю: эффективность. Большая модель — как огромный внедорожник, иногда он нужен, но чаще просто кушает больше ресурсов и не всегда даёт пропорциональную отдачу. Qwen3.6-27B — скорее крепкий “универсал”: не рекордный по размеру, зато собранный, натренированный на нужные навыки и, главное, хорошо организованный внутри. Короче, в реальной работе часто важнее не “сколько лошадиных сил”, а как они запряжены.

Кто такие люди за Qwen: зачем Alibaba вообще делает открытые модели

Alibaba — это, по сути, огромный «комбайн» из e-commerce (Taobao/Tmall), платежей, логистики и, что важно, облачных сервисов Alibaba Cloud. И вот тут становится понятно, почему им жизненно нужны свои ИИ-модели вроде Qwen3.6 27B: если у тебя облако, тебе выгодно, чтобы люди запускали ИИ именно на твоей инфраструктуре, покупали GPU, хранение, инструменты для разработки. Плюс конкуренция давит со всех сторон — западные модели, китайские игроки, open-source сообщество. Нельзя просто «подождать», пока кто-то сделает лучше: ИИ становится такой же базовой технологией, как базы данных или поисковый движок.

Почему часть моделей они выкладывают открыто под Apache 2.0? Тут не только идеализм. Открытая лицензия снимает головную боль с юристами и бизнеса: можно легально брать модель, дорабатывать, встраивать в продукт и продавать. Для обычных людей это означает более доступные инструменты: сегодня ты можешь гонять 27B локально (условно, на машине с 18–24 ГБ VRAM в кванте), не отдавая данные «в облако». Для малого бизнеса — шанс быстро собрать саппорт-бота, помощника программиста или анализатор документов, не подписываясь на дорогие API и не завися от чужих правил.

И есть ещё человеческий мотив. Команде разработчиков банально интереснее, когда модель трогают тысячи людей по миру: баги быстрее всплывают, идеи прилетают оттуда, откуда не ждёшь, репутация растёт. Открытость — это и про доверие (“смотрите, вот веса, пробуйте сами”), и про скорость инноваций: когда вокруг модели появляется экосистема плагинов, гайдов и форков, ты выигрываешь в гонке, даже если часть «пирога» раздаёшь бесплатно. В глобальной конкуренции иногда так и надо — не закрываться, а наоборот, шумно выйти на улицу и сказать: «Окей, давайте мериться качеством по-честному».

Три короткие истории: как Qwen3.6 «ведёт себя», когда задача становится сложной

История 1 — «путается в требованиях и уточняет»

Я кидаю Qwen3.6 задачу: «Сделай мне план статьи про Qwen3.6-27B, но чтобы без технички, и ещё добавь пару цифр». Она сначала отвечает почти на скорости — как будто «поняла, сейчас накидаю» — и выдаёт бодрый черновик. А потом, на втором круге, вдруг притормаживает: «Подожди, “без технички” — это без сравнений и бенчмарков тоже, или цифры можно оставить?» И вот в этот момент чувствуется переключение: быстрый режим — это черновик на салфетке, вдумчивый — это когда она проверяет, не противоречит ли одно другому. Я отвечаю: «Оставь две цифры, но без “сухих таблиц”». Она уточняет ещё раз, совсем по-человечески: «Цифры про размер модели и окно контекста ок?» После этого текст получается ровнее, и она уже не расплывается: упоминает «27 млрд» и «очень длинный контекст», но не превращает всё в пресс-релиз. И да, приятно, что она не делает вид, будто всё поняла с первого раза — иногда лучше переспросить, чем уверенно уехать не туда.

История 2 — «находит ошибку и чинит по шагам»

Я даю ей кусок кода, который падает на банальной штуке: где-то не тот тип данных, где-то переменная внезапно None. В быстром режиме она сходу бросает пару гипотез: «Проверь входные данные», «Посмотри, где формируется список». Но потом я прошу: «Не гадай, разберись спокойно», и она как будто сбавляет темп — начинает идти по шагам, почти как коллега на созвоне. Сначала просит минимальный пример воспроизведения (да, прям так), потом предлагает вставить 2–3 лог-строчки и посмотреть, на каком шаге всё ломается. Дальше — аккуратно: «Если тут приходит пусто, давай защитимся вот так; если нет — значит, проблема выше по цепочке». И что важно, она не прыгает сразу к “магическому” решению, а держит линию: проверка → вывод → правка → повторная проверка. В конце она ещё и напоминает прогнать пару кейсов (условно, 5–10 входов), чтобы не починить одно и не сломать другое. Ощущение такое: быстрый ответ — это “вот возможная причина”, а вдумчивый — “давай вместе доведём до железобетона”.

История 3 — «держит длинный контекст и не теряет нить»

Мы с ней обсуждаем продукт: сначала требования, потом ограничения, потом тон текста, потом примеры — и всё это растягивается на длинную переписку. В какой-то момент я сам забываю, что просил в начале, и начинаю противоречить себе: «Сделай коротко… хотя нет, добавь деталей… и вообще без терминов, но с цифрами». Она в быстром режиме могла бы просто послушно выполнить последнюю фразу, но тут она снова “притормаживает и думает”: мягко напоминает, что у нас уже было правило «живой язык, 2–4 абзаца, до 200 слов» и что цифры просили оставить “пару, не больше”. И это ощущается как внимательность, а не занудство: она не читает лекцию, а бережно возвращает разговор на рельсы. Дальше она собирает всё в один текст так, будто реально держала в голове всю нить — тон, ограничения, примеры, даже мелкие предпочтения. Я меняю один пункт (“без таблиц”), и она не ломает весь материал, а перестраивает только нужный кусок. В итоге не приходится по десять раз напоминать, что «мы же договаривались» — она помнит. И да, для пользователя это выглядит просто: на простых местах она отвечает быстро, а на сложных — делает паузу и как будто проверяет себя, чтобы не потерять смысл.

Фокус с длинной памятью: как ей удаётся не “забывать” на сотнях страниц

Длинный контекст у Qwen3.6 27B проще всего представить как огромный рабочий стол. У обычной модели стол маленький: ты разложил пару листов, отвернулся — и половина уже в ящике, приходится снова доставать и объяснять, что к чему. А тут стол реально широкий: контекстное окно — порядка сотен тысяч токенов, то есть можно держать перед глазами и оглавление документа, и спорный абзац из середины, и примечания в конце — одновременно. Не «магия памяти», а просто больше места, куда складываются текущие куски текста, на которые модель опирается, когда отвечает.

И из этого вытекает важная штука: меньше ощущения, что ты разговариваешь с человеком, который всё время отвлекается. Когда модель видит большую часть материала сразу, она реже просит “а напомни, что было в начале”, меньше ломает логическую нить и лучше держит структуру — например, в коде это проявляется так: она может соотнести интерфейсы, конфиги и пару ключевых файлов не по догадке, а потому что они реально лежат у неё “на столе”. В больших текстах примерно то же самое: меньше случайных противоречий между разделами, меньше плясок с повторными вводными.

Но важно не обольщаться: даже с длинным контекстом модель может перепутать детали, пропустить маленькую, но критичную строчку, или уверенно “додумать” то, чего в исходнике нет. Обычно это заметно по признакам: ответ звучит слишком гладко, но не даёт точных ссылок на конкретные места (“где именно это в тексте/коде?”), путает имена/параметры, или внезапно меняет терминологию. Хорошая привычка — просить её показать, на какие фрагменты она опирается, и проверять ключевые утверждения: длинный стол помогает, но от человеческой проверки он, увы, не освобождает.

Неочевидное сравнение с конкурентами: где Qwen3.6 выигрывает «по ощущениям»

Если сравнивать Qwen3.6‑27B с крупными закрытыми моделями и гигантскими MoE-системами, то её “фишка” не столько в абстрактной мощи, сколько в ощущениях от использования. Она реально приземлённая: её можно поднять локально на одной нормальной видеокарте (в квантизации это порядка 18–24 ГБ VRAM, в зависимости от сборки и аппетитов), и дальше работаешь без вечного “а что там с лимитами/тарифами/доступом”. Для многих это вдруг становится решающим: стоимость выходит предсказуемой, потому что ты платишь железом и электричеством, а не за каждый запрос и каждую “длинную мысль”. Плюс банальная, но важная вещь — контроль над данными. Код, документы, внутренние инструкции остаются у тебя, и это не только про паранойю, а про нормальный комплаенс и спокойствие команды.

Есть ещё неочевидный момент: гибкость тонкой настройки и вообще кастомизации. С закрытыми моделями ты часто упираешься в “ну вот вам промпт и всё”, а здесь можно подогнать модель под стиль поддержки, под терминологию продукта, под структуру тикетов — и это ощущается как “она говорит на нашем языке”. Да, это зависит от задачи и качества данных, но когда попадает — экономит часы. И по скорости отклика тоже приятный баланс: Qwen3.6‑27B обычно даёт быстрый, ровный ответ без ощущения, что каждое уточнение превращается в дорогую длинную сессию. У огромных MoE бывает эффект “то летит, то задумалась”, особенно если инфраструктура неидеальная.

И ещё про “агентные задачи”, по-человечески. Это когда модель не просто выдаёт совет, а действует как помощник, который делает шаги: открыл проект, посмотрел структуру, нашёл нужный файл, предложил правку, проверил, что ничего не сломалось, и только потом сформулировал итог. Например, “почини падение теста” или “добавь логирование в этот модуль и обнови конфиг” — не один ответ, а маленькая цепочка действий. Закрытые модели, конечно, могут быть сильнее в некоторых вещах — скажем, в особенно тонких формулировках, редких знаниях или мультимодальных сценариях “из коробки”. Но если вам важны локальный запуск, контроль, вменяемая цена и стабильное качество на практических задачах, Qwen3.6‑27B выглядит очень здравым компромиссом.

Доступ по API: как «подключить мозг» Qwen3.6 и что важно знать в России

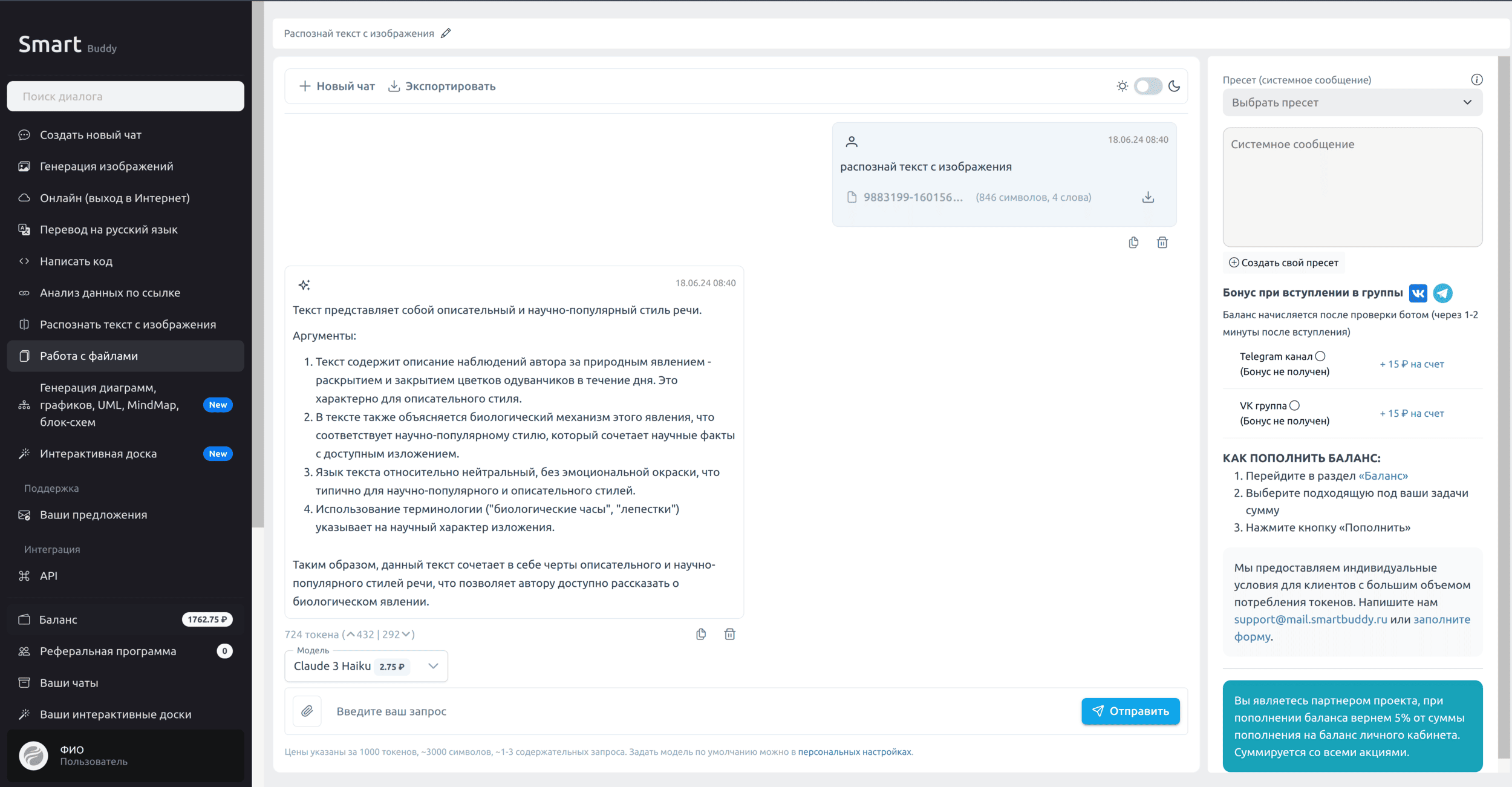

Я сделал SmartBuddy так, чтобы к Qwen: Qwen3.6 27B можно было подключаться без плясок с бубном. По сути, вы получаете стабильный и надежный API-доступ к модели — и можете спокойно встраивать её в свои проекты, ботов, пайплайны или IDE-рутину.

Что это дает на практике:

-

Стабильный доступ к API Qwen: Qwen3.6 27B — без внезапных “то работает, то нет”.

-

Оплата в рублях и вообще без боли: подходят любые российские карты.

-

Интеграция простая: подключились по ключу — и поехали, никаких дополнительных настроек и костылей.

-

Техподдержка на русском: можно писать как есть, человеческими словами, я пойму.

-

Готовые интеграции (если не хочется вручную клеить API):

-

IDE / Cursor IDE

-

n8n, Make.com

-

BoltAI, Cherry Studio

-

SillyTavern

-

Документация и быстрый старт лежат здесь: https://api.smartbuddy.ru

Пример запроса (curl)

curl https://api.smartbuddy.ru/v1/chat/completions \

-H "Authorization: Bearer YOUR_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "qwen/qwen3.6-27b",

"messages": [

{"role": "system", "content": "Ты полезный ассистент для разработчика."},

{"role": "user", "content": "Сгенерируй короткий пример функции на Python, которая валидирует email."}

],

"temperature": 0.2

}'Я правда рад новым пользователям: если вы только регистрируетесь, я подготовил приветственный бонус для всех — чтобы можно было сразу потестить Qwen3.6 27B в деле, без раздумий и лишней бюрократии.

Решайте любые задачи с помощью ИИ — от генерации текста до создания изображений и видео.

Текст и код

Генерация контента, перевод, анализ данных и автодополнение кода.

Изображения, видео и музыка

Создание иллюстраций, видеоконтента и уникальных треков любого жанра.

Диаграммы, графики и схемы

Визуализация данных, построение графиков и генерация блок-схем.

Личный кабинет

-

Приоритетная обработкаЗапросы от пользователей личного кабинета обрабатываются в первую очередь

-

Бонус за регистрациюСтартовый бонус на счёт личного кабинета (~20 запросов), без регистрации - 3 запроса

-

Все передовые нейросетиВ личном кабинете представлен широкий выбор нейросетей (120+).

-

Генерация реалистичных изображенийMidjourney 6.0, Stable Diffusion XL, Dall-E 3, Playground v2.5, Flux.1 Schnell, Flux.1 Dev, Flux.1 Pro, Flux.1.1 Pro, Kolors, Recraft v3, GPT Image 1 (low), GPT Image 1 (medium), GPT Image 1 (high), Google: Nano Banana, Google: Nano Banana Pro, FLUX.2 Flex, FLUX.2 PRO, FLUX.2 MAX, Google: Nano Banana 2

-

Создание музыкиНейросеть Suno создает музыку на основе вашего текста

-

Нет ограничения на количество символовБез регистрации вы можете отправить запрос не более 1000 символов

-

Работа с файламиПоддержка всех популярных форматов: pdf, excel, word, powerpoint, odt, c, js, php, py, html, sql, xml, yaml, markdown, txt, json, csv, png, jpeg и другие

-

Удобный вспомогательный чатНа всех страницах проекта, для получения быстрых ответов