Детектив вокруг названия: существует ли Gemma 4 31B и почему это важно

Иногда в сети всплывает что-то вроде «Gemma 4 31B», и звучит это убедительно — будто модель уже есть, просто “не для всех”. Но с нейросетями это часто похоже на маленькое расследование: есть (а) официальные релизы (их можно нормально проверить), есть (б) утечки/черновики (скриншоты, намёки в коммитах, странные архивы), и есть (в) фанатские сборки — квантизации, порты, “улучшенные” версии с громкими названиями. И вот где люди обычно путаются: квантизация может выглядеть как новая модель (“31B, Q4, супер-быстро”), хотя по сути это просто другой формат хранения весов, а не новый релиз.

Вот простой чек‑лист, без техбэкграунда — чтобы понять, реальна ли модель:

- Официальный блог Google/DeepMind и анонсы: есть ли прямое упоминание “Gemma 4” и размера?

- Model card: нормальная карточка модели с датой, лицензией, ограничениями, примерами.

- GitHub‑репозитории: смотрим, это официальная организация или левый форк; есть ли теги релиза, не один ли подозрительный коммит.

- Hugging Face: кто автор (Google/DeepMind или ноунейм), сколько скачиваний, есть ли ссылка на model card/публикацию.

- Vertex AI каталог: если модель правда “гугловая”, она часто светится там как продуктовая позиция.

Признаки доверия: совпадающие названия в разных официальных местах, понятная лицензия, аккуратные версии, ссылки друг на друга. Признаки недоверия: “утекло от знакомого”, только один торрент/гуглдиск, нет model card, автор — вчерашний аккаунт, описание в стиле “самая мощная 31B, без пруфов”. И да, даже если конкретного размера «31B» нигде нет, семейство Gemma всё равно можно понять по публичным версиям: как Google обычно именует линейку, какие есть реальные размеры, какие задачи и форматы поддерживаются — и уже от этого плясать, а не от красивой цифры в заголовке.

Как она ощущается в быту: мини‑сцены вместо списка «применений»

1) «Я путаюсь в письмах и уже не понимаю, кто от кого что хочет»

Я открываю почту, там 27 тредов, и пишу в Gemma 4 31B: «Сведи всю переписку в 5 пунктов и скажи, что мне ответить». Хороший результат — короткое резюме по фактам, кто что запросил, дедлайны, и черновик ответа в моём тоне, без лишней воды. Но модель иногда уверенно «додумывает» причины конфликта или приписывает людям обещания, которых в письмах нет, и это прям опасно. Лучше так: «Вот письма (ниже). Сначала перечисли только цитируемые факты с ссылкой на фрагменты, потом — 2 варианта ответа: нейтральный и жёсткий. Если чего-то нет в тексте — так и напиши».

2) «Надо понять договор, а у меня мозг выключается на третьей странице»

Я кидаю кусок договора и спрашиваю: «Объясни простыми словами, что я подписываю, и где риски». Хороший ответ — человеческое объяснение, список «кто кому что должен», штрафы, сроки, и красные флажки вроде автопродления или одностороннего расторжения. А вот где Gemma 4 31B подводит: может перепутать цифры из разных пунктов или слишком уверенно трактовать юридический смысл, как будто это консультация. Переформулировка спасает: «Сделай таблицу: пункт → что означает → риск → что уточнить у юриста. Не интерпретируй сверх текста; цитируй формулировки и отмечай неопределённости».

3) «Хочу выучить тему без занудства, но чтобы реально запомнить»

Сидя вечером, я пишу: «Объясни мне градиентный спуск как другу, без формул, за 10 минут». Хороший результат — понятная метафора, 1–2 примера из жизни и мини-проверка в конце (“объясни своими словами”). Ошибка у модели обычно такая: она разгоняется, кидает термины типа “гиперплоскость”, а потом ещё и уверяет, что «всё просто», хотя ничего не ясно. Лучше так: «Объясни в 3 уровнях: (1) совсем просто, (2) чуть глубже, (3) где чаще всего путаются. Потом задай мне 5 вопросов и проверь ответы; если ошибусь — поправь мягко».

4) «Нужен план поездки, но у меня ограничения и я не хочу сюрпризов»

Я говорю: «Сделай маршрут на 3 дня в Стамбуле: бюджет до 25 000₽, без музеев, с ребёнком, без длинных очередей». Хороший ответ — расписание по часам с запасом, районы рядом друг с другом, места “на случай дождя”, и честные примечания типа “в это время может быть толпа”. А модель иногда галлюцинирует: придумывает «детские зоны» там, где их нет, путает время работы, или бодро обещает «без очередей», будто она там стояла вчера. Рабочая версия запроса: «Составь 2 варианта маршрута (активный/спокойный). Для каждого пункта укажи: почему подходит ребёнку, примерное время в пути, и что проверить перед поездкой (часы работы/билеты/очереди). Если не уверен — напиши “нужно уточнить”».

5) «Разбор картинки/скриншота: я вижу, но не понимаю, что тут важно»

Я кидаю скриншот ошибки и пишу: «Что это за ошибка и как починить?». Хороший результат — модель сначала точно переписывает текст со скрина, выделяет ключевую строку, предлагает 2–3 гипотезы и просит недостающие детали (ОС, версия, что делал до этого). А типичная ошибка — она “угадывает” содержание картинки, путает одну ошибку с другой и уверенно предлагает команду, которая вообще не к месту. Лучше так: «Сначала дословно распознай текст на скриншоте и покажи его мне. Потом: 3 возможные причины + шаги проверки по порядку. Ничего не выдумывай, если текста на скрине нет — спроси уточнение».

Кто это сделал и зачем: Google DeepMind и ставка на «открытые» модели

Google DeepMind в этой истории — как персонаж‑инженер с двумя лицами. С одной стороны, у них есть «закрытые» флагманы в облаке: мощные, отполированные, но ты видишь только результат, а не механизм. С другой — линейка Gemma, и если говорить про ожидаемую/условную Gemma 4 31B, это как “вот вам мотор, держите ключи и крутите сами”. Им важно, чтобы экосистема росла не только вокруг их серверов, а вокруг идей и людей, которые могут допилить, адаптировать, встроить в свой продукт без вечной зависимости от API.

«Открытые веса» — это когда тебе дают не просто чат‑окошко, а сами параметры модели. Ты можешь запустить её локально, ограничить доступ к данным, зафиксировать версию. Для бизнеса это контроль и приватность: например, резюме договоров или техподдержка могут крутиться внутри периметра, без отправки текста в облако. И да, по деньгам тоже: вместо счёта за миллионы токенов — один раз настроил железо. Даже 31B в 4‑битной квантизации часто помещается на одной машине с 24–48 ГБ VRAM (или на нескольких GPU), и это уже “по‑настоящему своё”.

Но DeepMind не делает вид, что это игрушка. У Gemma есть лицензия, политика использования, ограничения по вредному контенту и безопасности — не юридический ад, просто рамки. И в этом, честно, плюс: большой компании важно, чтобы модели жили «в поле», но не превращались в неконтролируемый хаос.

Миф о «31B»: почему размер — не единственная мера ума

Миллиарды параметров — это, по сути, «внутренние ручки настройки» модели: чем их больше, тем больше она может удержать в себе разных шаблонов речи, фактов, стилей, связей. Но это не равно «умнее всегда». Это как объём словаря vs умение вести разговор: можно знать 100 тысяч слов и всё равно говорить путано, а можно с меньшим словарём — но чётко и по делу. Большая условная Gemma 4 31B чаще лучше ловит нюансы, держит тон, аккуратнее пишет по-русски (особенно в сложных темах), но за это платишь скоростью и ресурсами.

Важный момент — контекстное окно. Если ты кормишь модели длинный договор на 70 страниц или пачку переписки, маленькая модель может «забывать» начало и делать странные выводы. Большое окно позволяет реально работать с длинными документами, а не угадывать. Плюс, если заявлена мультимодальность, то удобнее: картинка + текст (скрин, график, таблица) — и модель объясняет, что там, без плясок с OCR.

Практическое правило простое: 31B оправдана, если нужен лучший русский, сложные инструкции, длинные контексты, анализ и стабильность (и есть бюджет/видеопамять — это может быть десятки ГБ). Меньшая модель — если нужен быстрый чат, черновики, суммаризация, работа на ноутбуке/сервере подешевле, или когда ты всё равно используешь поиск/базу знаний и не ждёшь «магии» от самой модели.

Нечестное сравнение с конкурентами: где Gemma может быть сильнее, даже если это не видно по бенчмаркам

Если говорить про Gemma‑подобную «Gemma 4 31B» (то есть открытую модель 31B‑класса, которую реально можно держать у себя), то она выигрывает не столько «в баллах», сколько в ощущении контроля. Закрытые API‑модели (типа GPT/Claude) часто умнее “из коробки”, но сегодня ответ один, завтра — чуть другой: обновили модель, поменяли фильтры, и привет, воспроизводимость уплыла. А с локальными весами проще: зафиксировал версию, сид, промпт — и результат предсказуемее. Плюс данные. Когда у тебя юр‑тексты или внутренняя аналитика, мысль «это не уехало наружу» прям успокаивает.

Про стоимость владения тоже есть нюанс. API может быть дешёвым на старте, но если у вас поток — счёт растёт тихо и неприятно. Локально, допустим, одна машина с GPU 24–48 ГБ (часто достаточно для 31B в 4‑бит) — это больно в покупке, зато потом предсказуемо. И кастомизация: LoRA‑дотюн на своих примерах делает стиль стабильнее, чем вечная борьба с промптами в закрытом API.

А вот «маленькие быстрые» модели (условные 3–8B, мобильные/edge) — это про скорость и дешевизну, но на длинных инструкциях они быстрее “расползаются”: забывают условия, перескакивают стиль, начинают импровизировать. Бенчмарки тут как краш‑тест: полезно знать, что машина выживает при ударе, но каждый день важнее другое — насколько она ровно держит полосу, не дёргается и не требует шаманства с настройками. Если вам нужен контроль + кастомизация + стабильный стиль, 31B‑класс обычно попадает в сладкую точку между «вечно дорого по API» и «слишком маленькая, чтобы не бесить».

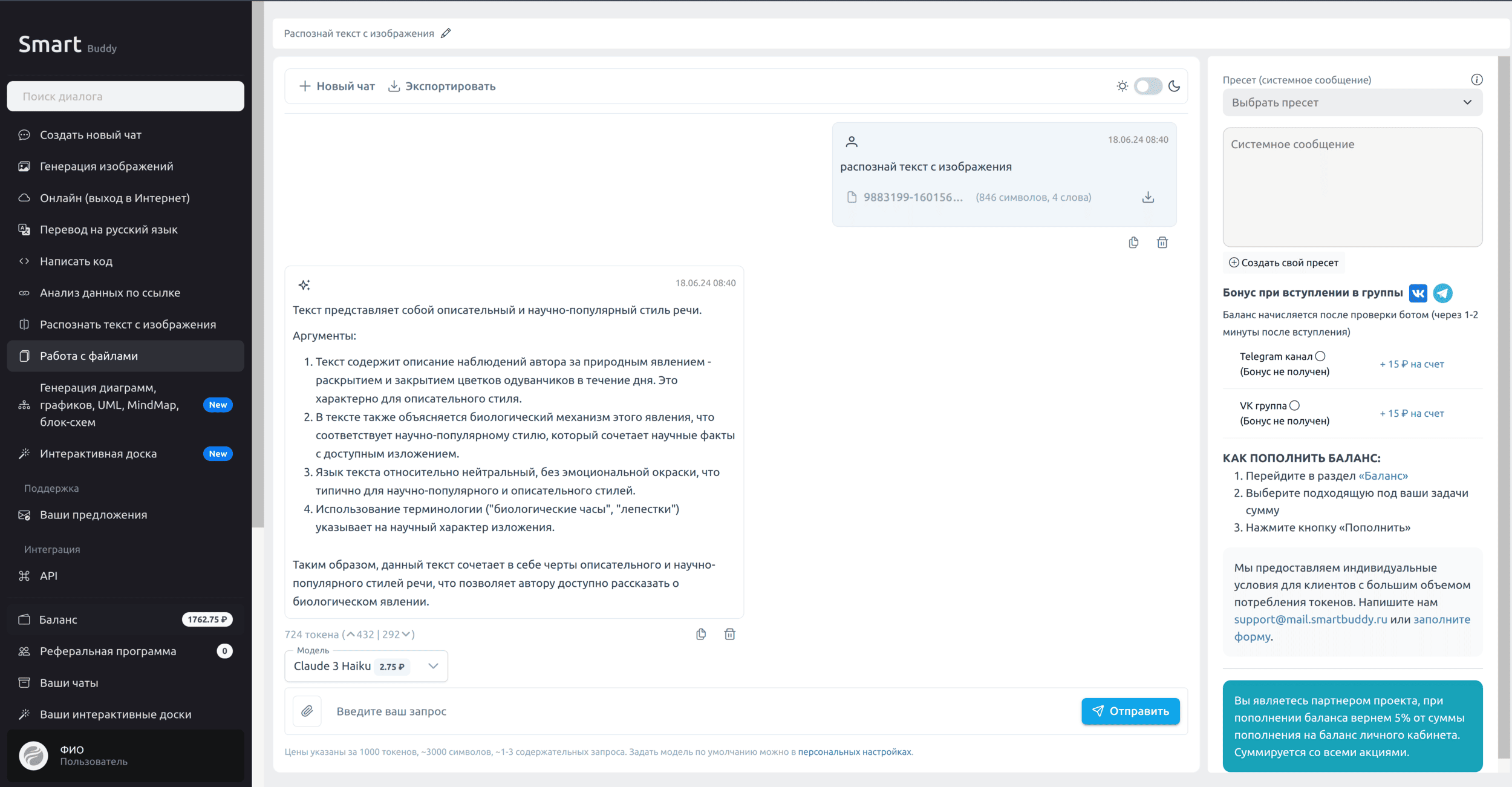

Доступ по API: как подключать и что делать в России

Я сделал SmartBuddy, чтобы вы могли спокойно дергать API модели google/gemma-4-31b-it без плясок с бубном: доступ стабильный, прокси/ключи/лимиты — всё прозрачно, а интеграция реально простая. Документация и примеры лежат тут: https://api.smartbuddy.ru — открыл, скопировал, поехали.

Что обычно особенно заходит разработчикам:

- Оплата в рублях и любыми российскими картами (да, это прям боль закрывает)

- Подключение без доп. настроек: один API-ключ и стандартные запросы

- Поддержка на русском — можно писать “как есть”, без канцелярита

- Готовые интеграции: IDE, n8n, BoltAI, Cherry Studio, SillyTavern, Make.com, Cursor IDE

Пример запроса (OpenAI-совместимый формат; детали эндпоинтов — в доках):

curl -s https://api.smartbuddy.ru/v1/chat/completions \

-H "Authorization: Bearer $SMARTBUDDY_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "google/gemma-4-31b-it",

"messages": [

{"role":"system","content":"Отвечай кратко и по делу."},

{"role":"user","content":"Сгенерируй 5 идей для Telegram-бота."}

]

}'Я правда рад новым пользователям — поэтому всем зарегистрировавшимся я подготовил приветственный бонус (он начисляется автоматически после регистрации).

Решайте любые задачи с помощью ИИ — от генерации текста до создания изображений и видео.

Текст и код

Генерация контента, перевод, анализ данных и автодополнение кода.

Изображения, видео и музыка

Создание иллюстраций, видеоконтента и уникальных треков любого жанра.

Диаграммы, графики и схемы

Визуализация данных, построение графиков и генерация блок-схем.

Личный кабинет

-

Приоритетная обработкаЗапросы от пользователей личного кабинета обрабатываются в первую очередь

-

Бонус за регистрациюСтартовый бонус на счёт личного кабинета (~20 запросов), без регистрации - 3 запроса

-

Все передовые нейросетиВ личном кабинете представлен широкий выбор нейросетей (120+).

-

Генерация реалистичных изображенийMidjourney 6.0, Stable Diffusion XL, Dall-E 3, Playground v2.5, Flux.1 Schnell, Flux.1 Dev, Flux.1 Pro, Flux.1.1 Pro, Kolors, Recraft v3, GPT Image 1 (low), GPT Image 1 (medium), GPT Image 1 (high), Google: Nano Banana, Google: Nano Banana Pro, FLUX.2 Flex, FLUX.2 PRO, FLUX.2 MAX, Google: Nano Banana 2

-

Создание музыкиНейросеть Suno создает музыку на основе вашего текста

-

Нет ограничения на количество символовБез регистрации вы можете отправить запрос не более 1000 символов

-

Работа с файламиПоддержка всех популярных форматов: pdf, excel, word, powerpoint, odt, c, js, php, py, html, sql, xml, yaml, markdown, txt, json, csv, png, jpeg и другие

-

Удобный вспомогательный чатНа всех страницах проекта, для получения быстрых ответов