Qwen: Qwen3 Coder Flash | Чат-бот

Бесплатный доступ к нейросети, без регистрации

Попробовать бесплатноОт идеи до реализации: Как появилась Qwen3 Coder Flash

Идея создания Qwen3 Coder Flash, на самом деле, витала в воздухе. Рынок AI-помощников для кода начал упираться в потолок: либо ты платишь за закрытые гиганты вроде GPT-4 и работаешь в облаке, либо используешь open-source модели, которые, ну, скажем честно, часто не дотягивали. Разработчикам хотелось мощи, но у себя на машине, без отправки кода непонятно куда. Alibaba уловила этот запрос на «суверенный AI» — мощный, открытый и локальный.

И вот тут, кажется, они сделали ставку на гениальную в своей простоте идею — архитектуру Mixture-of-Experts (MoE). Вместо того чтобы заставлять одного гигантского «эксперта» решать все задачи, они создали команду узких специалистов. В итоге модель Qwen3-Coder-30B Flash, имея 30,5 миллиардов параметров в запасе, для конкретной задачи активирует всего около 3 миллиардов. То есть, мы получаем эффективность огромной сети по цене небольшой. Это и стало тем самым прорывом, который позволил совместить несовместимое: производительность и экономичность.

А дальше был чисто стратегический ход. Создание именно Flash-версии — это не столько про технологию, сколько про людей. Они взяли свою мощную разработку и сделали её доступной для масс, упаковав в скромные 19 ГБ, которые можно запустить на обычном игровом ноутбуке. Конечно, за этим стоит колоссальная работа: отобрать 36 триллионов токенов для обучения, настроить «маршрутизацию» между экспертами, найти баланс при квантовании, чтобы не потерять в качестве. Но результат говорит сам за себя — рекордные показатели в бенчмарках и, что важнее, реальная польза для тысяч разработчиков по всему миру.

Чем может удивить Qwen3 Coder Flash?

Самое интересное в Qwen3 Coder Flash — это, конечно, как он умудряется быть таким мощным и одновременно доступным. Вся магия кроется в архитектуре Mixture-of-Experts (MoE). Представьте себе: общая база знаний модели — это внушительные 30,5 миллиардов параметров, но для решения конкретной задачи в каждый момент времени задействуются только 3 миллиарда. И вот тут-то и кроется вся соль. Благодаря этому подходу, модель, способная конкурировать с гигантами вроде GPT-4, сжимается до ~19 ГБ и спокойно запускается локально через Ollama. Это уже не просто теория, а реальность для многих разработчиков, у которых нет доступа к кластерам с десятками GPU.

На практике это означает, что модель не пытается «глубоко задуматься», как её старшие собратья. Она работает в режиме «flash» — мгновенный отклик для конкретных задач. Нужно быстро накидать бойлерплейт для нового React-компонента, переписать громоздкую функцию на Python под более современные стандарты или сгенерировать SQL-запрос для сложной выборки? Вот для этого Qwen3 Coder Flash подходит идеально. А поддержка более 350 языков программирования — это не просто цифра для маркетинга, а гарантия, что модель не спасует перед редким фреймворком или старым проектом на Cobol. И всё это — на вашем железе, без отправки кода на сторонние серверы.

Сравнение с конкурентами: Почему Qwen3 Coder Flash лучше других?

Когда смотришь на Qwen3 Coder Flash рядом с гигантами вроде GPT-4 или Claude 4, первое, что бросается в глаза — это не просто цифры в бенчмарках. Главное тут — философия. GPT-4 — это, по сути, огромный, монолитный мозг, который задействует почти всю свою мощь для любой задачи. А Qwen3, благодаря своей архитектуре Mixture-of-Experts (MoE), работает совершенно иначе. Представьте, что из 30.5 миллиардов параметров для ответа на ваш запрос активируются только самые нужные 3 миллиарда. Это как иметь команду из узкоспециализированных экспертов вместо одного всезнайки. Отсюда и невероятная скорость при локальном запуске на железе, которое модели от OpenAI или Anthropic просто не заметили бы.

Но, конечно, есть и обратная сторона медали. Версия Flash не зря так называется — она работает в режиме «non-thinking». Это значит, модель не будет рассуждать пошагово, как это часто делает GPT-4, раскладывая проблему на части. Она просто выдает готовый код. Для быстрой генерации функции или исправления очевидного бага — идеально. Но если нужна сложная логика или многоэтапный рефакторинг, где важен сам процесс «мысли», Qwen3 Flash может и не справиться. Это не универсальный солдат, а скорее молниеносный специалист для конкретных, четко поставленных кодинг-задач.

Технические детали: Как работает Qwen3 Coder Flash?

Так в чем же фишка этой архитектуры Mixture-of-Experts (MoE)? Если говорить совсем просто, то это не одна гигантская нейросеть, которая пытается решить все задачи сразу. Представьте себе скорее команду узких специалистов. Один — ас в Python, другой — гуру по базам данных, третий — мастер по фронтенду на React. Когда приходит задача, например, написать сложный SQL-запрос, специальный «менеджер» внутри сети не дёргает всех подряд, а вызывает именно «базиста». Это позволяет не тратить ресурсы на тех, кто в данный момент не нужен.

И вот тут-то и кроется магия Qwen3 Coder Flash. У модели целых 30,5 миллиардов параметров — это как бы вся ваша «команда» в сборе. Но в каждый конкретный момент для решения задачи активируется всего около 3 миллиардов. То есть, вместо того чтобы ворочать весь этот гигантский механизм, модель использует лишь небольшую, но самую релевантную его часть. Именно поэтому она такая 'Flash' — быстрая и относительно лёгкая, способная работать даже на домашнем компьютере, а не только на серверах корпораций.

По сути, это компромисс, который почти не компромисс. Вы получаете доступ к знаниям огромной модели, но без неподъемных требований к железу. Это не просто какая-то техническая деталь, а то, что делает технологию по-настоящему доступной и позволяет запустить мощный ИИ-кодер локально, не отправляя свой код на чужие серверы. И вот это, честно говоря, меняет правила игры.

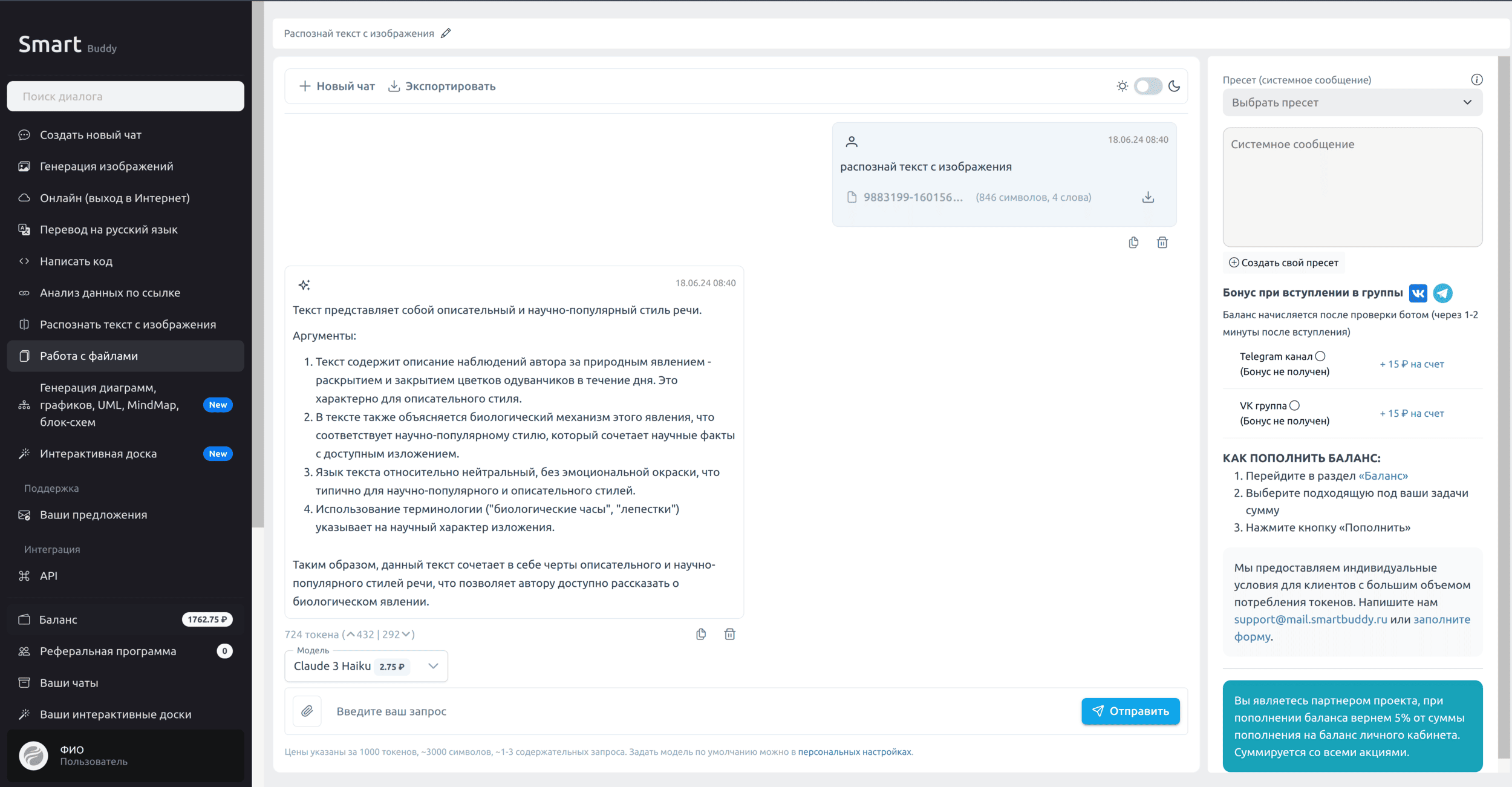

Доступ по API: Как использовать Qwen3 Coder Flash в России?

Если вы в России, то наверняка столкнулись с проблемой: официальный API Alibaba Cloud заблокирован. Ни через веб-интерфейс, ни через API напрямую доступа нет. VPN помогает не всегда, да и оплата китайскими сервисами — та еще квест.

SmartBuddy решает эту проблему в лоб:

- ✅ Полный доступ к API Qwen3 Coder Flash без ограничений

- ✅ Оплата рублями обычными российскими картами

- ✅ Не нужен VPN или танцы с бубном

- ✅ OpenAI-совместимый API — можно использовать привычные библиотеки

Как это работает на практике

Документация по API здесь: https://api.smartbuddy.ru

Вот рабочий пример запроса:

curl https://api.smartbuddy.ru/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer YOUR_API_KEY" \

-d '{

"model": "qwen3-coder-flash",

"messages": [

{

"role": "user",

"content": "Напиши функцию на Python для валидации email"

}

],

"temperature": 0.7

}'Что получаете:

- Модель отвечает на русском без проблем

- Скорость такая же, как у оригинального API

- Можете использовать в production без риска внезапной блокировки

Интеграция с популярными библиотеками

Поскольку API совместим с OpenAI, работает со всеми стандартными клиентами:

Python (openai):

from openai import OpenAI

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.smartbuddy.ru/v1"

)

response = client.chat.completions.create(

model="qwen3-coder-flash",

messages=[

{"role": "user", "content": "Оптимизируй этот SQL запрос"}

]

)JavaScript (openai):

import OpenAI from 'openai';

const openai = new OpenAI({

apiKey: 'YOUR_API_KEY',

baseURL: 'https://api.smartbuddy.ru/v1'

});

const completion = await openai.chat.completions.create({

model: 'qwen3-coder-flash',

messages: [{ role: 'user', content: 'Найди баг в этом коде' }]

});Никаких дополнительных настроек — просто меняете base_url и работаете как обычно.

Вдохновение от Alibaba: Команда, стоящая за Qwen3 Coder Flash

За созданием Qwen3 стоит, конечно же, не просто безликая корпорация, а вполне конкретная команда инженеров и исследователей из Alibaba Cloud. И вот тут начинается самое интересное. Их мотивация — это не только догнать и перегнать западных гигантов вроде OpenAI или Google, хотя этот элемент соревнования очевиден. На самом деле, их амбициозная цель — создать по-настоящему открытую и доступную экосистему для разработчиков. Они не просто выложили код в опенсорс; они сделали ставку на то, чтобы мощный ИИ мог работать локально, на железе обычного пользователя, а не только в дорогих облачных кластерах.

Их экспертиза видна буквально во всём. Взять хотя бы архитектуру Mixture-of-Experts (MoE) — это не самый простой путь, но он позволяет добиться невероятной эффективности, что и сделало возможным появление компактной Flash-версии. А обучающая выборка в 36 триллионов токенов? Это не просто гигантская свалка данных, а результат колоссальной работы по отбору и очистке информации, где пригодился весь опыт Alibaba в работе с Big Data. Они явно хотели создать не просто модель, которая хорошо проходит тесты, а инструмент, решающий реальные, повседневные задачи программистов. Именно этот прагматизм и привёл к появлению Qwen3 Coder — мощного, но при этом удивительно доступного помощника.

Будущее программирования с Qwen3 Coder Flash

Это, на самом деле, меняет правила игры. Долгое время мощные ИИ-помощники были доступны только через облачные API, что создавало вопросы к скорости и конфиденциальности данных. А Qwen3 Coder Flash ломает эту парадигму. Подумать только: модель с общим весом в 30,5 миллиардов параметров, сжатая до ~19 ГБ, которую можно запустить локально на своем же ноутбуке! Это уже не просто удобный инструмент, а полноценный, суверенный ассистент, который не отправляет ваш код на чужие серверы.

И вот тут начинается самое интересное. Для опытных разработчиков это не угроза, а мощнейший инструмент, эдакий «второй пилот», который возьмёт на себя рутину: напишет тесты, проведет рефакторинг старого легаси-кода или набросает бойлерплейт для нового микросервиса. А для новичков порог входа в профессию снижается просто драматически. Вместо того чтобы часами гуглить ошибку в синтаксисе, можно просто спросить у локальной нейросети, получив мгновенный ответ и объяснение. По сути, это смещает фокус с «как написать код» на «какую проблему мы решаем», делая разработку более творческим процессом.

Решайте любые задачи с помощью ИИ — от генерации текста до создания изображений и видео.

Текст и код

Генерация контента, перевод, анализ данных и автодополнение кода.

Изображения, видео и музыка

Создание иллюстраций, видеоконтента и уникальных треков любого жанра.

Диаграммы, графики и схемы

Визуализация данных, построение графиков и генерация блок-схем.

Личный кабинет

-

Приоритетная обработкаЗапросы от пользователей личного кабинета обрабатываются в первую очередь

-

Бонус за регистрациюСтартовый бонус на счёт личного кабинета (~20 запросов), без регистрации - 3 запроса

-

Все передовые нейросетиВ личном кабинете представлен широкий выбор нейросетей (120+).

-

Генерация реалистичных изображенийMidjourney 6.0, Stable Diffusion XL, Dall-E 3, Playground v2.5, Flux.1 Schnell, Flux.1 Dev, Flux.1 Pro, Flux.1.1 Pro, Kolors, Recraft v3, GPT Image 1 (low), GPT Image 1 (medium), GPT Image 1 (high), Google: Nano Banana, Google: Nano Banana Pro, FLUX.2 Flex, FLUX.2 PRO, FLUX.2 MAX, Google: Nano Banana 2

-

Создание музыкиНейросеть Suno создает музыку на основе вашего текста

-

Нет ограничения на количество символовБез регистрации вы можете отправить запрос не более 1000 символов

-

Работа с файламиПоддержка всех популярных форматов: pdf, excel, word, powerpoint, odt, c, js, php, py, html, sql, xml, yaml, markdown, txt, json, csv, png, jpeg и другие

-

Удобный вспомогательный чатНа всех страницах проекта, для получения быстрых ответов